Gegevensbescherming in het AI-tijdperk

Begrijp de risico's, de veranderende regelgeving en de maatregelen om je gegevens te beschermen. Ontdek hoe verantwoorde databedrijven de voordelen van AI benutten, zonder de privacy in gevaar te brengen.

Moderne AI-tools transformeren hoe organisaties met data omgaan. AI-systemen, van eenvoudige machine-learning pipelines tot complexe Large Language Models (LLM's), verwerken, analyseren en leren voortdurend van enorme hoeveelheden persoonlijke en gedragsgegevens. Tegelijkertijd vergroot deze diepe integratie van AI de privacyrisico's: wat ooit passieve gegevensopslag was, wordt nu actieve en geautomatiseerde besluitvorming. De kernvraag is niet langer óf AI je gegevens zal beïnvloeden, maar hoe je die gegevens kunt beschermen in een wereld waarin AI overal aanwezig is. In dit artikel verkennen we de risico's die AI introduceert, hoe de regelgeving zich aanpast, wat dit voor jou betekent, en hoe organisaties klantgegevens op een verantwoorde en transparante manier kunnen beschermen.

Risico's

AI verandert hoe gegevens worden gebruikt, gedeeld en begrepen. Dit creëert nieuwe risico's waar veel organisaties niet op voorbereid zijn. AI-systemen verzamelen vaak meer gegevens dan nodig is, wat de kans op fouten, lekken of misbruik vergroot. Soms verzamelt AI gevoelige persoonlijke informatie, zoals gezondheids-, financiële of biometrische gegevens, die nooit bedoeld waren om samen te worden gebruikt of aan AI te worden verstrekt.

AI-tools gebruiken soms gegevens zonder duidelijke toestemming. Mensen begrijpen mogelijk niet volledig dat hun informatie wordt gebruikt om modellen te trainen of beslissingen te beïnvloeden. Gegevensstromen worden moeilijk te volgen, waardoor het lastig wordt om te bewijzen waar persoonlijke informatie vandaan komt, hoe deze door het systeem beweegt, of waarom een model een bepaalde output produceerde. Veel AI-modellen gedragen zich als zogenoemde black-boxes, waardoor het moeilijk is om uit te leggen waarom ze tot bepaalde uitkomsten komen. Dit kan leiden tot bias, oneerlijke beslissingen en schade aan individuen.

AI vergroot ook het risico op datalekken, modellekkage of data-exfiltratie. Gevoelige gegevens kunnen ontsnappen via onbedoelde outputs, logging of onveilige opslag. AI-systemen combineren vaak gegevens uit verschillende bronnen. Dit verhoogt de kans op privacyschendingen, omdat losse stukjes data, wanneer gecombineerd, meer kunnen onthullen dan oorspronkelijk bedoeld. Deze risico's groeien naarmate AI sneller, goedkoper en gemakkelijker te gebruiken wordt. De schaal en snelheid waarmee AI kan opereren, maken het moeilijker om gegevens te volgen, te auditen en te controleren. Het begrijpen van deze risico's is de eerste stap naar het bouwen van veilige en verantwoorde AI-systemen.

Regelgeving

Om deze risico's te bestrijden, beweegt de regelgeving snel. In de Europese Unie, waar wij gevestigd zijn en dus aan onderworpen zijn, blijft de Algemene Verordening Gegevensbescherming (AVG) het belangrijkste regelboek wanneer AI-systemen persoonsgegevens verwerken. De AVG noemt "AI" niet expliciet, maar definieert concepten zoals rechtmatige verwerking, toestemming, doelbinding, dataminimalisatie, transparantie en rechten van betrokkenen: principes die gelden ongeacht welke technologie wordt gebruikt. In 2024 werd de EU Artificial Intelligence Act (AI Act) wet. Deze nieuwe verordening voegt regels toe die specifiek zijn bedoeld voor AI. Het identificeert "high-risk" AI-systemen, bijvoorbeeld in werving, gezondheidszorg of kredietscorebepaling, en vereist strenger toezicht, documentatie, transparantie en menselijke tussenkomst wanneer dergelijke systemen worden gebruikt.

Wanneer een AI-systeem persoonsgegevens verwerkt, zijn zowel de AVG als de AI Act van toepassing. De overlap betekent dat organisaties moeten voldoen aan gegevensbeschermingsregels én AI-specifieke regels. Deze dubbele last kan uitdagend zijn, maar geeft ook duidelijkheid: betrokkenen behouden hun rechten en bedrijven moeten veilige, transparante AI-systemen bouwen. Tegelijkertijd letten toezichthouders steeds beter op. Zo eisen toezichthoudende autoriteiten steeds vaker grondige documentatie van gegevensstromen, beslissingslogica en risicobeoordelingen wanneer AI-systemen worden gebruikt.

Hierdoor kunnen bedrijven AI niet behandelen als een puur technische functie. Ze hebben goede governance nodig. Ze moeten gegevensbescherming en AI-compliancepraktijken inbedden in ontwerp, bouw en implementatie. Dit maakt goede datahygiëne en transparant databeheer essentieel voor elke AI-strategie van vandaag.

Wat dit voor jou betekent

Allereerst heb je recht op duidelijke en eerlijke informatie voordat je persoonsgegevens afstaat. Vóór eerste gebruik moet je weten welke gegevens de leverancier verzamelt, waarom deze worden verzameld en hoe ze zullen worden gebruikt. Je moet ook worden geïnformeerd over hoe je gegevens door hun systemen bewegen. Dat omvat of identificatoren worden gemaskeerd of verwijderd, hoe gegevens worden opgeslagen, wie er toegang toe heeft en hoe lang ze worden bewaard. Je moet toegang kunnen krijgen tot de gegevens die de leverancier over jou heeft. Als iets onjuist is, heb je een manier nodig om het te corrigeren. Als je niet langer wilt dat de leverancier je gegevens bewaart, moet je verwijdering kunnen aanvragen of verwerking kunnen beperken. Deze rechten maken deel uit van de Algemene Verordening Gegevensbescherming (AVG).

Als het AI-systeem profilering, scoring of geautomatiseerde besluitvorming gebruikt die jou beïnvloedt, verdien je zinvolle beoordeling of menselijk toezicht. Je verdient ook een duidelijke uitleg over hoe beslissingen worden genomen en de mogelijkheid om ze aan te vechten indien nodig. Je gegevens moeten worden beschermd met sterke technische en organisatorische waarborgen. Dat betekent veilige opslag, encryptie, korte bewaartermijnen en alleen verzamelen wat strikt noodzakelijk is. Dataminimalisatie, pseudonimisering en doelbinding moeten onderdeel zijn van de ontwerpkeuzes van de leverancier.

De leverancier moet ook transparante documentatie bijhouden. Je moet documenten kunnen opvragen en indien gewenst lezen, die tonen hoe hun AI werkt, welke gegevens deze gebruikt en hoe zij voldoen aan gegevensbeschermings- en ethische standaarden. Tot slot moet communicatie met de leverancier eenvoudig aanvoelen. Er moeten eenvoudige tools of processen zijn om je gegevens te bekijken, fouten te corrigeren, verwijdering aan te vragen of je af te melden voor bepaalde verwerkingen.

Hoe wij klantgegevens beschermen

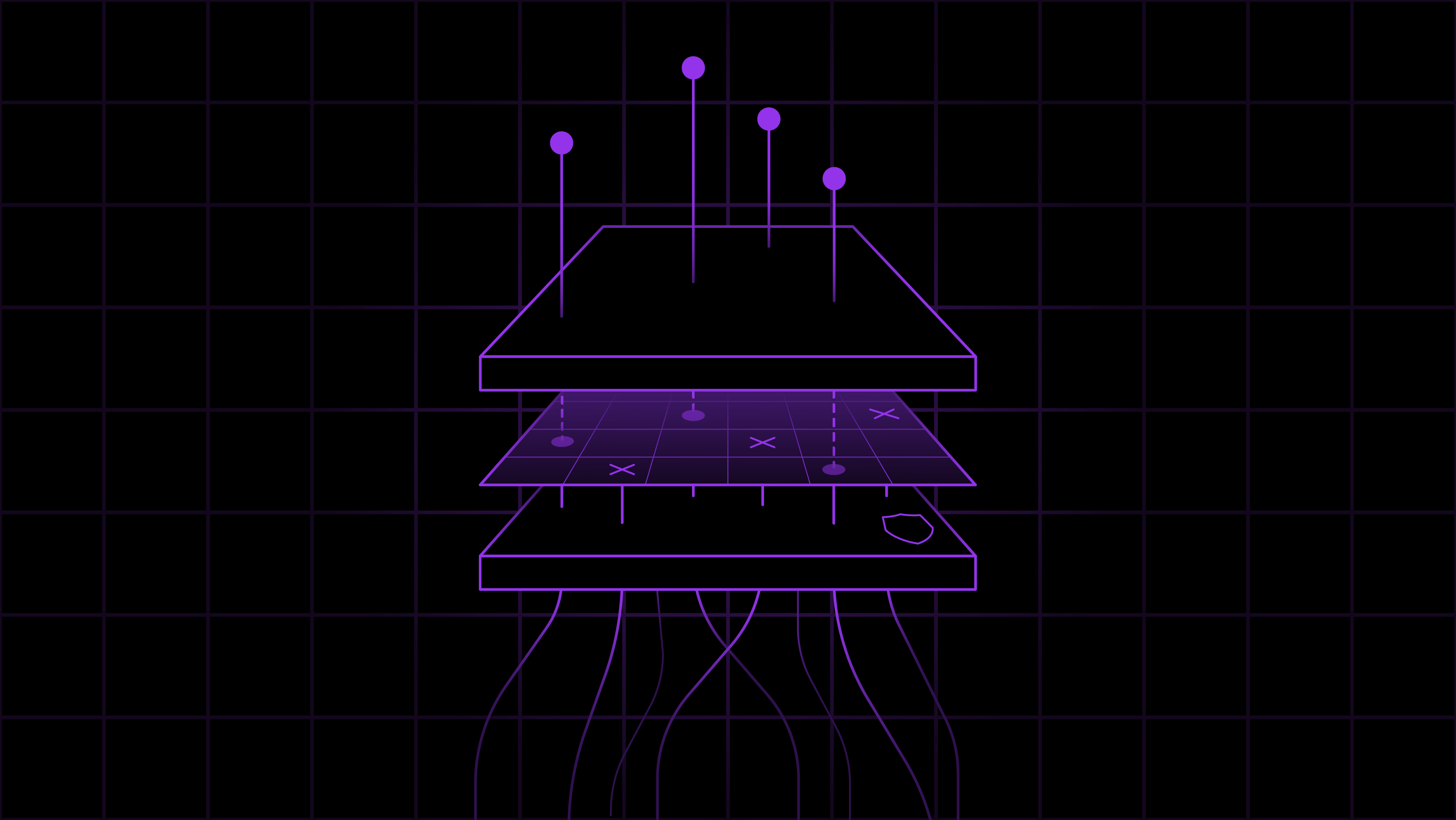

Wij vertrouwen niet op AI om gegevens veilig te houden. Als agentic-native bedrijf is dit ons uitgangspunt. Echte beveiliging komt van de deterministische controles die wij rond het model bouwen, niet van het model zelf. Op basis van dat principe passen wij de volgende maatregelen toe:

Je gegevens zijn volledig geïsoleerd. De data van elke organisatie is gescheiden op databaseniveau, bij ieder verzoek. Je contacten, e-mails, notities en CRM-gegevens worden nooit vermengd met die van een ander team.

Alles is versleuteld. Gegevens worden versleuteld tijdens transport en in opslag. Bestanden worden versleuteld met speciale cloudsleutels die aan je account zijn gekoppeld. E-mailgegevens en API-secrets worden met een aparte laag versleuteld voordat ze de database bereiken. API-secrets worden onomkeerbaar gehasht, zelfs wij kunnen ze niet herstellen.

Jij bepaalt wat de agent mag doen. Een permissiematrix laat je per resource en per actie instellen: toestaan, goedkeuring vereisen of blokkeren. Geen standaard volledige toegang, geen alles-of-niets-schakelaars. Gevoelige acties pauzeren en wachten op goedkeuring van je team voordat er iets wordt verstuurd of gewijzigd. Onbeoordeelde verzoeken verlopen automatisch na 14 dagen.

Alleen vertrouwde afzenders bereiken je agent. Je agent verwerkt alleen e-mails van afzenders die je expliciet hebt goedgekeurd. Alle anderen worden uitgefilterd voordat de agent ze ooit ziet.

Toegang is rolgebaseerd en overal afgedwongen. Drie gebruikersrollen (admin, developer en user) met duidelijke grenzen die worden afgedwongen in de interface én in de backend. Alleen admins kunnen agentpermissies beheren, acties goedkeuren of organisatie-instellingen wijzigen.

Wij trainen nooit op je gegevens. Je interacties vormen niet onze modellen of die van onze partners en worden nooit onderdeel van toekomstige output. Elk verzoek staat op zichzelf.

Wij volgen de AVG en gevestigde beveiligingsframeworks. Standaarden zoals SOC 2 en ISO 27001 sturen hoe wij toegangscontroles, logging, lekpreventie en auditing ontwerpen. Wij zijn nog niet gecertificeerd, maar werken daar naartoe.

Geen enkel systeem is perfect en dat claimen wij ook niet. Wij evalueren onze maatregelen regelmatig en verbeteren ze waar we kunnen. Transparant zijn over onze beperkingen is onderdeel van het verdienen van vertrouwen. En vertrouwen is de basis van het bouwen van verantwoorde AI systemen.

Krijg vroege toegang

Sluit je aan bij founders en sales teams die AI hun pipeline laten vullen.

- Geen creditcard nodig

- Menselijke goedkeuring voordat AI handelt

- Gebouwd en gehost in Europa

Vroege toegang

Wees een van de eersten die een AI-aangedreven CRM gebruikt.

Founding Users Benefit

Krijg toegang tot de private beta, directe invloed op onze roadmap en maatwerk integraties.